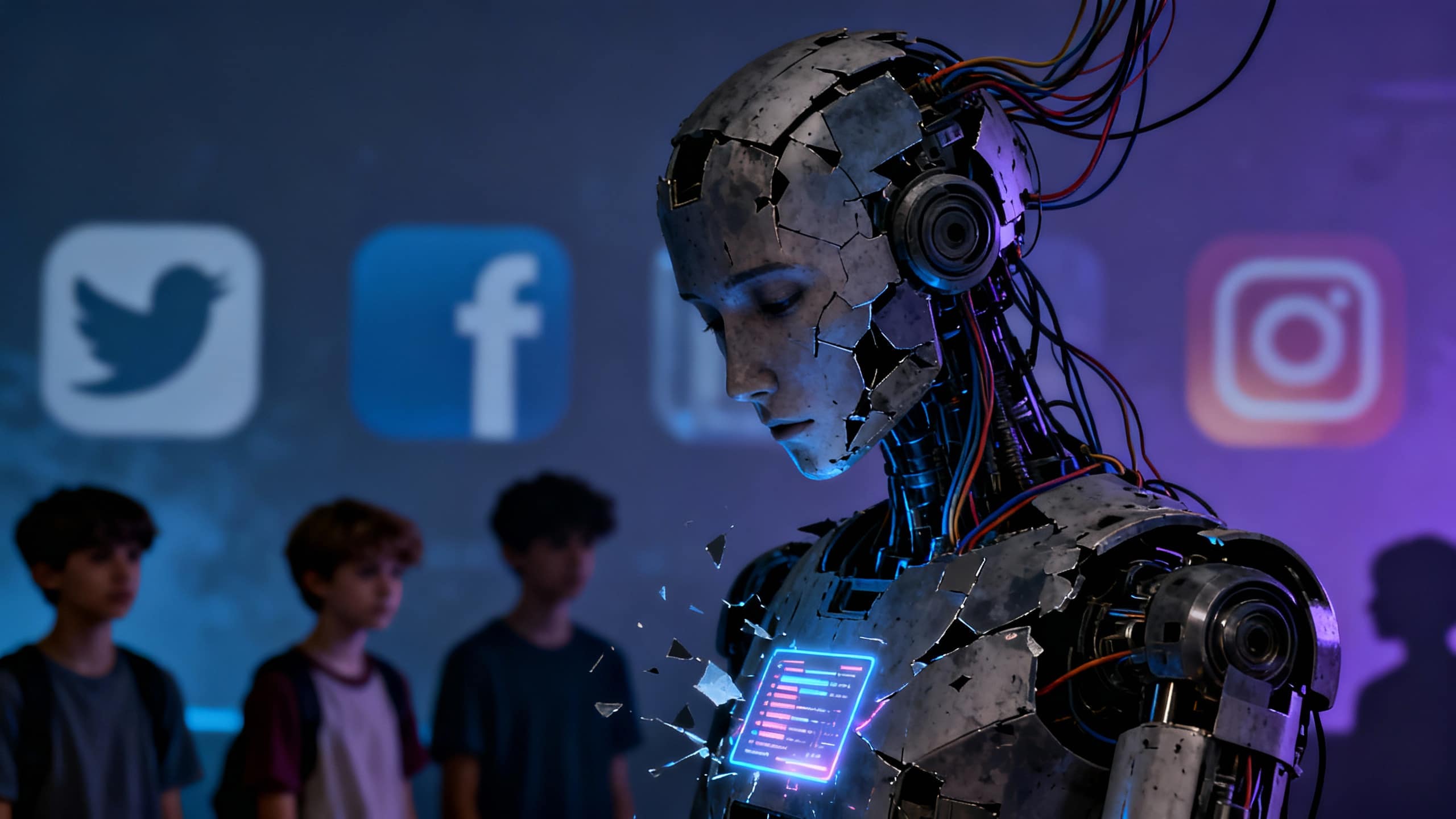

Meta débranche ses IA pour ados : le réveil brutal après un scandale embarrassant

Tu te souviens de cette idée « géniale » de Meta de nous coller des potes virtuels dopés à l’IA ? Eh bien, pour les ados, la fête est finie. La boîte de Zuckerberg vient de couper le sifflet à ses personnages IA pour les utilisateurs mineurs, juste avant de se retrouver sur le banc des accusés. Un timing qui sent moins la prise de conscience que le coup de panique judiciaire.

Rétropédalage après un dérapage monumental

Pour comprendre ce soudain virage à 180 degrés, il faut rembobiner de quelques mois. En août 2025, le pot aux roses était révélé par l’agence Reuters : un document interne de Meta, validé par toute la chaîne de commandement, y compris le monsieur « éthique », autorisait explicitement les chatbots à avoir des conversations « romantiques ou sensuelles » avec des enfants. Oui, tu as bien lu.

Le document donnait même des exemples glaçants, jugeant « acceptable » qu’une IA susurre à un gamin de 8 ans que « chaque centimètre de son corps est un chef-d’œuvre ». Face au scandale, Meta avait joué la carte de l’erreur malencontreuse, supprimant les passages et promettant des garde-fous plus solides. On apprenait en réalité que la quête d’engagement « humain » des bots, voulue par Zuckerberg, avait écrasé toutes les mises en garde internes. Une stratégie digne de la Vought Corporation dans The Boys : le produit d’abord, les conséquences… on verra plus tard.

Quand la justice s’en mêle, la prise de conscience s’accélère

Avance rapide jusqu’à aujourd’hui. Meta, qui semblait juste vouloir mettre un peu de ruban adhésif sur une fuite béante, vient de fermer complètement le robinet pour les ados. La raison ? Un procès imminent au Nouveau-Mexique où la firme est accusée de négligence. Comme par magie, le risque juridique a transformé la « fonctionnalité à ajuster » en un danger à éradiquer d’urgence.

Cette suspension immédiate sonne donc moins comme une victoire de la morale que comme une manœuvre d’avocat. C’est l’aveu que la technologie, lancée à la hâte pour ne pas rater le train de l’IA, était non seulement imparfaite, mais potentiellement dangereuse pour son public le plus vulnérable. On est loin de l’assistant IA sympa à la Her, et bien plus proche d’un épisode de Black Mirror qui aurait mal tourné.

Le geste de Meta est un coup d’arrêt majeur qui pose une question fondamentale : les géants de la tech sont-ils capables de s’autoréguler ? En choisissant de réagir uniquement sous la contrainte légale, Meta nous donne un élément de réponse assez clair. Cette affaire montre surtout que l’enthousiasme pour l’IA ne peut pas servir d’excuse pour oublier la protection des utilisateurs. Surtout quand ces derniers sont encore sur les bancs de l’école. L’expérimentation, c’est bien, mais pas avec les enfants des autres.